-

데이터 변경이력

데이터 변경이력 버전 일자 변경내용 비고 1.1 2023-11-21 데이터 최종 개방 1.0 2023-07-31 데이터 개방(Beta Version) 데이터 히스토리

데이터 히스토리 일자 변경내용 비고 2023-12-27 산출물 전체 공개 소개

자율주행 로봇의 실내외 통합 주행을 위한 주행 데이터 구축날씨 (맑음, 흐림, 비)와 아침/낮/저녁 등의 다양한 환경에서 실내 및 실외에서 로봇이 주행할 때 보이는 여러 객체들의 종류들과 객체 위치들의 데이터를 제공하여 실내 및/혹은 실외공간, 통합 공간 기반의 다양한 연구를 할 수 있는 데이터 제공

구축목적

실내 대공간의 기반으로 하는 이미지, 라이다와 같은 고차원 데이터를 수집하여 딥러닝을 통한 인식 및 map building을 수행 가능하도록 함 - 고차원 데이터를 획득하는 센서를 사용하여 데이터를 수집하는 것뿐만 아니라, IMU, Wheel encoder와 같은 단순 센서 데이터 또한 수집하여 연구 범위를 보다 넓힐 수 있음 - 실내 대공간에서 획득한 고차원 데이터에서 자율주행를 위해 인지할 수 있는 모든 객체 및 심볼 라벨링을 수행 함으로써 자율주행 연구를 수행 할 때의 ground-truth로서 활용함 - 로봇의 현재 위치, 상태, 주변 상황 등의 라벨링을 ground-truth로서 활용하여 SLAM 및 path planning을 수행하기 위한 알고리즘의 기반으로써 활용함

-

메타데이터 구조표 데이터 영역 교통물류 데이터 유형 이미지 데이터 형식 PNG/PCD 데이터 출처 직접 수집 라벨링 유형 세그멘테이션, 큐보이드 라벨링 형식 json 데이터 활용 서비스 공원내 자율배송 로봇에 적용 : 실내와 실외 공간 통합 배송으로, 실내(식당)에서 음식 배송 출발 실외(공원 벤치)까지 배송하고 되돌아오면서, 자율배송 중 다양한 이벤트(문 개폐 및 혼잡도에 따른 이벤트)항목에 대한 인식을 이용 배송로봇의 자율 주행 통합 솔루션: 동적 장애물 검출 및 예측을 하고 대형시설 실내·인접 공간 내 객체인식을 하면서 원하는 위치에 배송을 하면서 자율주행체 혹은 사람 등의 동적 객체 간 충돌을 예방하기 위한 자율주행 모빌리티의 경로 및 속도 변경을 가능하게 하는 배송 로봇에 활용 데이터 구축년도/

데이터 구축량2022년/객체인식 (1Hz) 원천데이터 166,070장 라벨링데이터 166,070장 메타데이터 138개 위치추정 (10Hz) 원천데이터 264,114장 메타데이터 55개 -

1. 데이터 구축 규모

데이터 구축 규모 구 분 원천 데이터 가공 데이터 실내 대형 시설의 주변 사물 인식용 데이터 (png/jpg 및 pcd 포맷) (1 Hz) 라이다(pcd 포멧) : 83,035장 영상(png 포멧) : 83,035장 라이다 데이터용 JSON 파일 : 83,035장 총 166,070장 실내 : 40,079장 실외 : 42,956장 영상 데이터용 JSON 파일 : 83,035장 실내 : 40,079장 실외 : 42,956장 총 166,070장 위치 확인용 데이터 (10Hz) 라이다(pcd 포멧) : 132,057장 영상(png 포멧) : 132,057장 (비식별화) 총 264,114장 메타데이터 객체 인식용 (1HZ) (txt,,csv, png, yaml 포멧) - 시나리오 개수 69개 calibration 데이터(txt) : 2개 camera, camera_lidar 총 138개 위치 확인용(10Hz) - 시나리오 개수 11개 시나리오 당 메타데이터 구성 calibration 데이터(txt) : 2개 camera, camera_lidar csv데이터(csv) : 1개 map데이터(png, yaml) : 2개 총 55개 총합 객체인식 (1Hz) : 166,208 166,070장 (166,070장+138개) 위치추정 (10Hz) : 264,169 (264,114장+55개) 총 430,277 ○ 라벨링 데이터 구성

1) semantic segmentationsemantic segmentation No 항목명 타입 필수 설명 범위 비고 1 data_key string y 원본 데이터 이름 2 objects array y 객체의 정보 2-1 class_name string y class의 이름 2-2 annotation array y 어노테이션 라벨링 타입 2-3 properties object 어노테이션이 생성된 프레임번호 2-4 property_name string 속성값의 이름 2-5 option_name string 속성 옵션의 이름 3 meta object y 추가 정보 3-1 location string y 장소 3-2 scenario string y 시나리오 3-3 weather string y 날씨 3-4 date_time string y 일시 3-5 size string y 이미지 사이즈 3-5-1 width number y 가로 사이즈 3-5-2 height number y 세로 사이즈 3-6 congestion string y 혼잡도 프로퍼티 설명(property_name)

프로퍼티 설명(property_name) No 항목명 타입 필수 설명 범위 비고 1 data_key string y 원본 데이터의 이름 2 objects array y 객체의 정보 2-1 class_name string y class의 이름 2-2 annotation array y 어노테이션의 정보 2-2-1 position object y 포지션 좌표 2-2-1-1 x number y x좌표 2-2-1-2 y number y y좌표 2-2-1-3 z number y z좌표 2-2-2 rotation_quaternion object y 회전 쿼터니언 2-2-2-1 x number y 벡터 x값 2-2-2-2 y number y 벡터 y값 2-2-2-3 z number y 벡터 z값 2-2-2-4 w number y 회전을 표현하는 스칼라값 2-2-3 size object y 객체 크기 2-2-3-1 x number y x방향 크기 2-2-3-2 y number y y방향 크기 2-2-3-3 z number y z방향 크기 3 meta object y 추가 정보 3-1 location string y 장소 3-2 scenario string y 시나리오 3-3 weather string y 날씨 3-4 date_time string y 시간 3-5 size string y 이미지 사이즈 3-5-1 width number y 가로 사이즈 3-5-2 height number y 세로 사이즈 3-6 congestion string y 혼잡도 2) LiDAR

LiDAR No 항목명 타입 필수 설명 범위 비고 1 data_key string y 원본 데이터의 이름 2 objects array y 객체의 정보 2-1 class_name string y class의 이름 2-2 annotation array y 어노테이션의 정보 2-2-1 position object 포지션 좌표 2-2-1-1 x float y x좌표 2-2-1-2 y float y y좌표 2-2-1-3 z float y z좌표 2-2-2 rotation_quaternion object 회전 쿼터니언 2-2-2-1 3-6+D894:G898 int y 벡터 x값 2-2-2-2 y int y 벡터 y값 2-2-2-3 z int y 벡터 z값 2-2-2-4 w int y 회전을 표현하는 스칼라값 2-2-3 size object 객체 크기 2-2-3-1 x float y x방향 크기 2-2-3-2 y float y y방향 크기 2-2-3-3 z float y z방향 크기 3 meta object y 추가 정보 3-1 location string y 장소 3-2 scenario string y 시나리오 3-3 weather string y 날씨 3-4 date_time string y 시간 3-5 size string y 이미지 사이즈 3-6 congestion string y 혼잡도 3) 위치추정 데이터

아래의 데이터는 위치 추정(확인)에 사용되는 데이터 라벨임데이터는 위치 추정(확인)에 사용되는 데이터 라벨 No 항목명 타입 필수 설명 범위 비고 1 time string y 수집 시간 2 encoder_L string 왼쪽 인코더 값 3 encoder_R string 오른쪽 인코더 값 4 angular_vel_x string y 각속도 x 5 angular_vel_y string y 각속도 y 6 angular_vel_z string y 각속도 z 7 linear_acc_x string y 선형가속도 x 8 linear_acc_y string y 선형가속도 y 9 linear_acc_z string y 선형가속도 z 10 pose_x string y 로봇 위치 x 그림 참조 11 pose_y string y 로봇 위치 y 그림 참조 12 pose_theta string y 로봇의 주행 각 그림 참조 13 GT_pose_x string Ground truth X 좌표 14 GT_pose_y string Ground truth Y 좌표 15 GT_pose_theta string Ground truth theta 좌표 16 GPS_lon string GPS 경도 보정 데이터 17 GPS_lat string GPS 위도 보정 데이터 18 gt string Gorund Truth 데이터 여부 T or F 19 image_path string y image 데이터 저장 경로 20 lidar_path string y lidar 데이터 저장 경로 참조 그림) 방향 예시

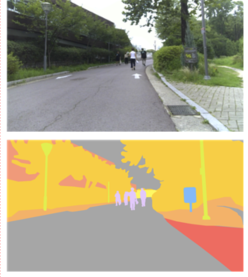

[카메라 이미지]

• 원천 데이터 • 라벨 데이터

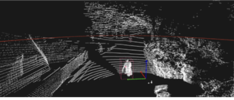

[LiDAR 이미지]

• 원천 데이터 • 라벨 데이터

-

-

AI 모델 상세 설명서 다운로드

AI 모델 상세 설명서 다운로드 AI 모델 다운로드ㅇ세그멘테이션 기반 실내외 객체(주변 사물) 인식 모델

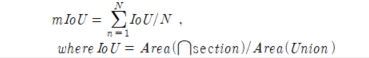

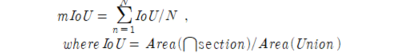

- 실내외 환경에서 객체를 학습하고, 이를 기반으로 객체들을 탐지하고 분류학습모델 개발 항목 학습모델 개발 항목 항목명 대형시설 실내·인접 세그멘테이션 기반 객체 인식/탐지 임무 의미론적 분할(Semantic Segmentation) 지표 mIoU(mean Intersection over Union) 측정 산식

학습조건 ※ Epoch 수: 600 ※ batch size: 1920 ※ optimizer: SGD ※ learning rate: 0.01 ※ weight decay: 0.0005 ※ momentum: 0.9 ※ nesterov: false ※ flip: true ※ multi scale: true ※ downsample rate: 1 ※ scale factor: 16 데이터셋 분할 • 학습용 데이터셋: 32,000장(80%) (수량, 비율) • 검증용 데이터셋: 4,000장(10%) • 평가용 데이터셋: 4,000장(10%) 구축목표 총 데이터 수량 대비 비율 100%(40000/40000) 기타사항 - HRNet+OCR의 레퍼런스 코드에서 사용하는 cityscapes 마스킹과 마찬가지로 BGR 마스킹을 opencv함수를 사용하여 Grayscale로 변환하여 사용 - opencv함수는 YPrPb 변환 방식을 사용하고 있으며 이에 따라 OUT_Tree와 OUT_Fence, OUT_Bench와 IN_Undefined Stuff, OUT_Grass와 Wheelchair 클래스가 동일한 Grayscale로 마스킹 되는 문제가 발생. 따라서 해당 클래스는 직접 매핑값을 지정하여 총 30개의 클래스에 대하여 학습 진행. 데이터셋에서 제공하는 총 33개 클래스(실외 정적 객체 14종, 실외 정적 객체 12종, 동적 객체 7종)에 대해 입력받은 RGB 영상 내에서 각 클래스가 차지하는 픽셀 영역을 추정하는 HRNetV2-OCR 모델 개발

HRNetV2-OCR 모델 및 입출력 구조

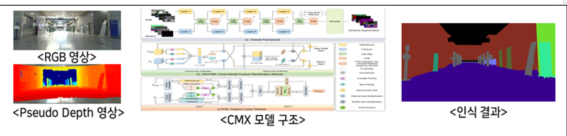

ㅇ세그멘테이션 및 Point Cloud 데이터 기반 실내외 객체(주변 사물) 인식 모델

- 실내외 환경에서 객체를 학습하고, 이를 기반으로 객체들을 탐지하고 분류학습모델 개발 항목 학습모델 개발 항목 항목명 대형시설 실내·인접 세그멘테이션 및 점군 기반 객체 인식/탐지 임무 의미론적 분할(Semantic Segmentation) 및 점군을 활용 지표 mIoU(mean Intersection over Union) 측정 산식

학습조건 ※ Epoch 수: 600 ※ batch size: 1920 ※ optimizer: SGD ※ learning rate: 0.01 ※ weight decay: 0.0005 ※ momentum: 0.9 ※ nesterov: false ※ flip: true ※ multi scale: true ※ downsample rate: 1 ※ scale factor: 16 데이터셋 분할 • 학습용 데이터셋: 32,000장(80%) (수량, 비율) • 검증용 데이터셋: 4,000장(10%) • 평가용 데이터셋: 4,000장(10%) 구축목표 총 데이터 수량 대비 비율 100%(40000/40000) 기타사항 - HRNet+OCR의 레퍼런스 코드에서 사용하는 cityscapes 마스킹과 마찬가지로 BGR 마스킹을 opencv함수를 사용하여 Grayscale로 변환하여 사용 - opencv함수는 YPrPb 변환 방식을 사용하고 있으며 이에 따라 OUT_Tree와 OUT_Fence, OUT_Bench와 IN_Undefined Stuff, OUT_Grass와 Wheelchair 클래스가 동일한 Grayscale로 마스킹 되는 문제가 발생. 따라서 해당 클래스는 직접 매핑값을 지정하여 총 30개의 클래스에 대하여 학습 진행. - 데이터셋에서 제공하는 총 33개 클래스(실외 정적 객체 14종, 실외 정적 객체 12종, 동적 객체 7종)에 대해 입력받은 RGB 영상 내에서 각 클래스가 차지하는 픽셀 영역을 추정하는 CMX 모델 개발

- 3D 라이다를 통해 획득한 3D 점구름 자료는 카메라 화면으로 투영하여 pseudo depth 영상으로 만든 후, RGB 영상과 함께 모델에 입력

CMX 모델 및 입출력 구조

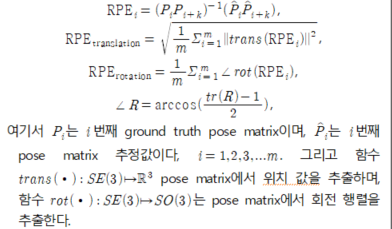

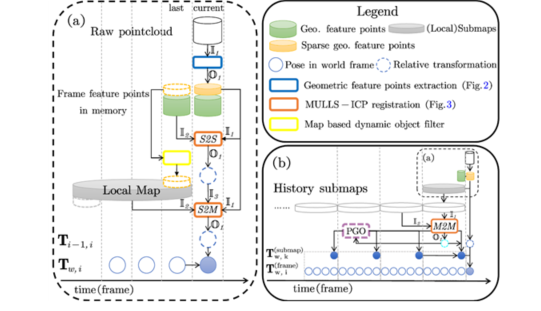

ㅇ위치 확인/추정 모델

- 실내외 환경에서 자율주행체가 습득한 위치를 학습하고, 이를 기반으로 현 위치를 추정학습 모델 개발 항목 학습 모델 개발 항목 항목명 대형시설 실내·인접 위치인식 임무 영상 기반 위치 추정(Visual Localization) 지표 RPE(Relative Pose Error) 측정 산식

학습조건 ※ Epoch 수: 100 ※ batch size: 4 ※ optimizer: RMSprop ※ learning rate: 0.0001 ※ ResNet 층수: 18 데이터셋 분할 • 학습용 데이터셋: 105,618장 (수량, 비율) • 검증용 데이터셋: 45,695장 • 평가용 데이터셋: 5,708장

MULLS 알고리즘 구조

학습모델 개발 항목 학습모델 개발 항목 항목명 자율이동체의 이동 경로 계획 임무 경로 계획(Path Planning) 지표 Opt(Path Optimality Ratio) 측정 산식

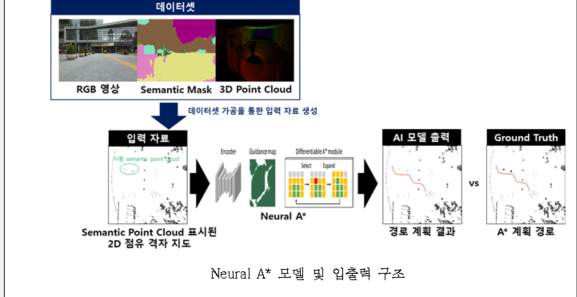

학습조건 ※ Epoch 수: 50 ※ batch size: 100 ※ optimizer: RMSprop ※ learning rate: 0.001 ※ g_ratio(A* 탐색 비용함수를 구성하는 항들의 가중치 비율): 0.5 ※ Tmax(A* 탐색 범위): 0.25 ※ 이미지 엔코더 종류: UNet ※ 이미지 엔코더 깊이: 4층 데이터셋 분할 여러 데이터셋 수집 환경에 대한 지도 이미지(최소 크기: 1872x2049)에 회전, 이동, 좌우반전 등의 변환을 적용한 후, 여러 작의 작은 이미지로 나누어 데이터셋 구성 (수량, 비율) • 학습용 데이터셋: 35,000장 • 검증용 데이터셋: 4,400장 • 평가용 데이터셋: 4,400장 MULLS 알고리즘 구조 - 데이터셋에서 제공하는 RGB 영상 내 객체들을 인식하고, 각 객체의 종류마다 설정된 안전 영역을 고려한 경로를 계획할 수 있도록 semantic point cloud 지도를 입력받아 경로를 계획하는 Neural A* 모델 개발

-

데이터 성능 점수

측정값 (%)기준값 (%)데이터 성능 지표

데이터 성능 지표 번호 측정항목 AI TASK 학습모델 지표명 기준값 점수 측정값 점수 1 위치 확인 성능 Object Detection SC-Depth V3 ATE 0.5 단위없음 0.45 단위없음 2 이미지 기반 객체 인식 성능 (시멘틱 세그멘테이션) Object Detection HRNET-OCR mIoU 65 % 65.98 % 3 라이다 기반 객체 인식 성능 Object Detection CMX mIoU 65 % 72.15 % 4 경로 계획 성능 Estimation Neural A* Opt 80 % 91.4 %

※ 데이터 성능 지표가 여러 개일 경우 각 항목을 클릭하면 해당 지표의 값이 그래프에 표기됩니다.

※ AI모델 평가 지표에 따라 측정값의 범위, 판단 기준이 달라질 수 있습니다. (ex. 오류율의 경우, 낮을수록 좋은 성능을 내는 것으로 평가됩니다)

-

설명서 및 활용가이드 다운로드

데이터 설명서 다운로드 구축활용가이드 다운로드1. 데이터 구성 및 포맷

데이터 구성 및 포맷 과제 데이터 포맷 비고 대형시설 실내 인접 자율배송 실내 사물 인식용 데이터 이미지파일(JPG) 데이터 실외 사물 인식용 데이터 포인트 클라우드(PCD) 위치인식용 데이터 json 이동경로계획 데이터 csv, txt, jpg, yaml 2. 데이터 분포

○ 시나리오(장소)별 분포

1) 도구공간

장소 분포: 어린이대공원(40%), 연세대 신촌캠퍼스(60%)

실내 및 실외 분포: 실내(12%), 실외(88%)

날씨 분포: 맑음(20%), 흐림(56%), 비(24%)

시나리오 분포: A(11%), B(12%), C(30%), D(17%), E(16%), F(14%)

시간대 분포: 혼잡(14%), 적정(40%), 한가(46%)2) 라스테크

실내 및 실외 분포: 실내(57%), 실외(43%)

장소 분포: 고려대학교 세종캠퍼스(32%), 대전컨벤션센터(68%)

날씨 분포: 맑음(52%), 흐림(38%), 비(10%)

시나리오 분포: A(15%), B(9%), C(8%), D(24%), E(29%), F(15%)

시간대 분포: 혼잡(22%), 적정(50%), 한가(28%)3) 에이텍티앤

실내 및 실외 분포: 실내(76%), 실외(24%)

장소 분포: EXCO(81%), 터미널(19%)

날씨 분포: 맑음(73%), 흐림(15%), 비(12%)

시나리오 분포: A(43%), B(38%), C(13%), D(6%)

시간대 분포: 혼잡(24%), 적정(55%), 한가(21%)4) 클래스 별 분포

클래스 별 분포 Semantic Class 개수 Lidar Class 개수 Undefined Stuff 232,706 Undefined Stuff 1,700 Wall 148,406 Wall 4,482 Driving Area 147,536 Pillar 8,344 Non Driving Area 90,651 Traffic Cone 1,338 Parking Line 118,049 No Parking Sign 314 Parking Area 90,120 Undefined Object 363 No Parking Area 569,806 Vehicle 14,047 Big Notice 53,778 Two-Wheeled Vehicle 147 Pillar 447,889 Stroller 75 Parking Area Number 84,973 Wheelchair 86 Disabled Icon 59,280 Shopping Cart 193 Women Icon 8,515 Human 707 Compact Car Icon 6,988 Speed Bump 18,144 Parking Block 183,632 Billboard 12,607 Toll Bar 3,808 Sign 88,953 No Parking Sign 13,484 Traffic Cone 58,831 Fire Extinguisher 17,015 Undefined Object 12,401 Two-wheeled Vehicle 5,903 Vehicle 496,699 Wheelchair 1,745 Stroller 1,658 Shopping Cart 16,834 Animal 1,569 Human 28,134 -

데이터셋 구축 담당자

수행기관(주관) : 강원대학교

수행기관(주관) 책임자명 전화번호 대표이메일 담당업무 박홍성 033-250-6346 hspark@kangwon.ac.kr 데이터 구축 총괄 수행기관(참여)

수행기관(참여) 기관명 담당업무 도구공간 데이터 수집 / 정제 ㈜라스테크 데이터 수집 / 정제 ㈜에이텍티앤 데이터 수집 / 정제 ㈜슈퍼브에이아이 데이터 가공 데이터 관련 문의처

데이터 관련 문의처 담당자명 전화번호 이메일 박홍성 033-250-6346 hspark@kangwon.ac.kr

-

인터넷과 물리적으로 분리된 온라인·오프라인 공간으로 의료 데이터를 포함하여 보안 조치가 요구되는 데이터를 다운로드 없이 접근하고 분석 가능

* 온라인 안심존 : 보안이 보장된 온라인 네트워크를 통해 집, 연구실, 사무실 등 어디서나 접속하여 데이터에 접근하고 분석

* 오프라인 안심존 : 추가적인 보안이 필요한 데이터를 대상으로 지정된 물리적 공간에서만 접속하여 데이터에 접근하고 분석 -

- AI 허브 접속

신청자 - 안심존

사용신청신청자신청서류 제출* - 심사구축기관

- 승인구축기관

- 데이터 분석 활용신청자

- 분석모델반출신청자

- AI 허브 접속

-

1. 기관생명윤리위원회(IRB) 심의 결과 통지서 [IRB 알아보기] [공용IRB 심의신청 가이드라인]

2. 기관생명윤리위원회(IRB) 승인된 연구계획서

3. 신청자 소속 증빙 서류 (재직증명서, 재학증명서, 근로계약서 등 택1)

4. 안심존 이용 신청서 [다운로드]

5. 보안서약서 [다운로드]

※ 상기 신청서 및 첨부 서류를 완비한 후 신청을 진행하셔야 정상적으로 절차가 이루어집니다. -

신청 및 이용관련 문의는 safezone1@aihub.kr 또는 02-525-7708, 7709로 문의

데이터셋 다운로드 승인이 완료 된 후 API 다운로드 서비스를 이용하실 수 있습니다.

API 다운로드 파일은 분할 압축되어 다운로드 됩니다. 분할 압축 해제를 위해서는 분할 압축 파일들의 병합이 필요하며 리눅스 명령어 사용이 필요합니다.

리눅스 OS 계열에서 다운로드 받으시길 권장하며 윈도우에서 파일 다운로드 시 wsl(리눅스용 윈도우 하위 시스템) 설치가 필요합니다.

※ 파일 병합 리눅스 명령어

find "폴더경로" -name "파일명.zip.part*" -print0 | sort -zt'.' -k2V | xargs -0 cat > "파일명.zip"

- 해당 명령어 실행 시, 실행 경로 위치에 병합 압축 파일이 생성됩니다.

- 병합된 파일 용량이 0일 경우, 제대로 병합이 되지 않은 상태이니 "폴더경로"가 제대로 입력되었는지 확인 부탁드립니다.

※ 데이터셋 소개 페이지에서 다운로드 버튼 클릭하여 승인이 필요합니다.

오프라인 데이터 이용 안내

본 데이터는 K-ICT 빅데이터센터에서도 이용하실 수 있습니다.

다양한 데이터(미개방 데이터 포함)를 분석할 수 있는 오프라인 분석공간을 제공하고 있습니다.

데이터 안심구역 이용절차 및 신청은 K-ICT빅데이터센터 홈페이지를 참고하시기 바랍니다.

국방데이터 개방 안내

본 데이터는 국방데이터로 군사 보안에 따라 AI허브에서 데이터를 제공하지 않으며,

군 담당자를 통한 별도의 사용 신청이 필요합니다.